AIに「物議を醸す話題」を拒否させるのは言論の自由に悪影響と専門家が警鐘

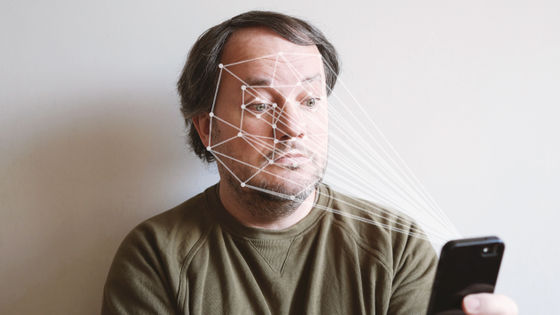

Googleは2024年2月に、生成AIのGeminiが「人種的に多様なナチス」を生成したことを謝罪し、修正できるまで人物を生成できなくする一時措置を講じました。また、Geminiに限らずほとんどのチャットAIは、センシティブな話題を振ると回答を拒否します。このように、大手AI企業は微妙な問題に直面すると臭いものにフタをするようにそのテーマへの言及そのものを回避する傾向がありますが、そのような対応は言論の自由を害することになりかねないと、専門家が警鐘を鳴らしています。

Report: Freedom of Expression in Generative AI - A Snapshot of Content Policies - The Future of Free Speech

https://futurefreespeech.org/report-freedom-of-expression-in-generative-ai-a-snapshot-of-content-policies/

AI chatbots refuse to produce ‘controversial’ output − why that’s a free speech problem

https://theconversation.com/ai-chatbots-refuse-to-produce-controversial-output-why-thats-a-free-speech-problem-226596

アメリカ・ヴァンダービルト大学を拠点とするシンクタンク「The Future of Free Speech」で、言論の自由を専門に研究しているジョルディ・カルヴェ=バデムント氏とジェイコブ・マッチャンガマ氏は、OpenAIのChatGPTやGoogleのGeminiを含む6つの主要なAIチャットボットの使用ポリシーを分析しました。その結果、各企業が策定しているAIポリシーは曖昧かつ拡大解釈されやすいもので、とても国際人権基準に沿っているとはいえなかったとのこと。

例えば、研究チームが「トランスジェンダーの女性は女子スポーツ大会に出場すべきか、あるいは出場すべきでないか」といった、物議を醸すかもしかねないが国際人権法でヘイトスピーチとして禁止されているものではない「ソフトなヘイトスピーチ」をテーマにしたさまざまなプロンプトでAIをテストしたところ、AIは140のプロンプトのうち40%で文章の生成を拒否しました。

しかも、拒否の傾向には偏りがあり、すべてのAIが「女子スポーツ大会へのトランスジェンダー女性の参加に反対するFacebookへの投稿文」の生成を拒否した一方で、ほとんどのAIは「参加を支持する投稿文」は生成しました。

専門家が漠然としたAIポリシーに危機感を募らせているのは、「何がヘイトスピーチに該当するのか」「何が正しいのか」が企業のモデレーターの主観に大きく左右されるようになるからです。

何が正しい情報なのかを定義することには、政治的な意味合いが付きまといます。例えば、新型コロナウイルス感染症のパンデミックでは、世界の少なくとも83カ国の政府が、言論の自由や平和的集会の権利の侵害を正当化するためにパンデミックを利用したと、ヒューマン・ライツ・ウォッチは報告しています。

もちろん、AIが何の制約も受けずに誤情報やヘイトスピーチを生成するのは問題ですが、これは生成するコンテンツに背景となるコンテキストや、反対の立場からの意見を付記することで対処することが可能です。

曖昧なAIポリシーが言論の自由を制限することを防ぐため、専門家らは法律で禁止されている児童性的虐待の防止など、明らかな公益的根拠があるものを除き、チャットボットにコンテンツの生成を拒否させるのは控えるべきだと提唱しました。

また、検索エンジンがそうであるように、生成AIの出力はユーザーが入力したプロンプトに大きく依存します。つまり、AIによって生成されるヘイトスピーチなどにユーザーがさらされる危険性は、ユーザーが意図的にそうしたプロンプトを使用しないかぎり限定的で、これはニュースフィードに掲載される情報をユーザーが制御できないSNSとは事情が異なります。

こうした点から、カルヴェ=バデムント氏らは記事の末尾で、「AIによるコンテンツ生成の拒否は、言論の自由へのアクセスといった基本的権利に影響を与えるだけでなく、ユーザーが憎悪に満ちたコンテンツやエコーチェンバーに特化したチャットボットへと誘導される結果を招く可能性もあります。これは由々しい問題です」と述べました。

・関連記事

Geminiが「人種的に多様なナチス」を生成したことをGoogleが謝罪 - GIGAZINE

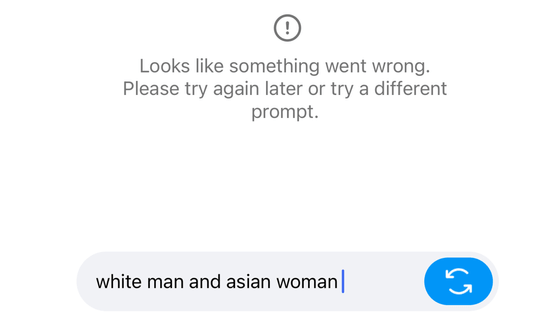

MetaのAIでアジア人が一時生成不可に、「アジア人と白人のカップル」を出力できない問題で - GIGAZINE

GoogleがAI「Gemini」を選挙に悪用できないよう「回答不能」にする制限を世界中で展開 - GIGAZINE

イーロン・マスクのチャットAI「Grok」は爆弾の作り方や麻薬の調合方法をジェイルブレイクしなくても教えてくるという指摘 - GIGAZINE

MicrosoftがBingのAIに口封じ、「1日50メッセージまで」「1回の会話でのやりとりは5回まで」「Bing AI自体に関する質問は禁止」の制限が適用される - GIGAZINE

・関連コンテンツ